AI w monitoringu pracowników – o jakiej kontroli w ogóle mowa?

Od klasycznej kontroli do algorytmów

Monitoring pracowników nie jest zjawiskiem nowym. Od lat pracodawcy stosują kamery wizyjne, systemy rejestracji wejść i wyjść, logi systemowe czy kontrolę służbowej poczty e‑mail. Różnica polega na tym, że narzędzia z elementami AI nie tylko rejestrują zdarzenia, ale również je analizują, łączą, przewidują i klasyfikują. Przestajemy mieć do czynienia wyłącznie z „nagrywaniem”, a wchodzimy w obszar profilowania pracowników przez algorytmy.

Klasyczny monitoring to zwykle dostęp do materiału „na żądanie” (np. przejrzenie nagrania z kamery po incydencie). Systemy z AI działają częściej w trybie ciągłym: analizują przepływy danych, wyłapują wzorce, tworzą alerty bezpieczeństwa albo oceny efektywności. Tym samym zwiększa się zakres przetwarzania danych osobowych, a także potencjalny wpływ na prywatność i relacje w miejscu pracy.

Równocześnie granica pomiędzy nadzorem nad wykonywaniem obowiązków, a nieakceptowalną ingerencją w życie prywatne staje się mniej oczywista. Algorytmy mogą „zobaczyć” więcej, niż człowiek zdążyłby kiedykolwiek obejrzeć lub przeanalizować: setki godzin nagrań, tysiące wiadomości, niuanse zachowań czy nawet emocji. Dlatego to, co formalnie jest „tylko” monitoringiem, w praktyce może być odbierane jako niemal totalna inwigilacja.

Jakie narzędzia AI już działają w firmach

Narzędzia AI w monitoringu pracowników działają dziś w kilku kluczowych obszarach. Część z nich jest widoczna dla pracownika (np. aplikacje mierzące czas pracy), inne działają „w tle”, jako funkcje wbudowane w systemy bezpieczeństwa czy platformy HR. Co do zasady można je podzielić na kilka grup:

- Monitoring produktywności – programy zliczające czas aktywności przed ekranem, analizujące używane aplikacje, otwierane pliki, liczbę wprowadzonych znaków, przerwy w pracy. AI może tu służyć do tworzenia scoringów efektywności, porównań między zespołami czy przewidywania ryzyka spadku wydajności.

- Bezpieczeństwo informacji – systemy DLP (Data Loss Prevention) z elementami uczenia maszynowego, które wykrywają nietypowe zachowania użytkownika: wysyłkę dużej liczby załączników na zewnętrzny adres, logowanie z nietypowej lokalizacji, niestandardowe pobieranie danych z systemów. Algorytmy pomagają odróżnić normalne odchylenia od potencjalnych nadużyć.

- AI w HR i kadrach – narzędzia analizujące wyniki pracy, historię projektów, dane z systemów CRM czy ERP, by wspierać oceny okresowe, decyzje o awansach, premiowaniu czy rekrutacjach wewnętrznych. W bardziej zaawansowanej wersji pojawiają się modele przewidujące „ryzyko odejścia” pracownika lub jego „potencjał rozwojowy”.

- Monitoring komunikacji – analiza metadanych i, w ograniczonym zakresie, treści wiadomości e‑mail lub komunikatorów służbowych, np. pod kątem wycieku tajemnic przedsiębiorstwa, mobbingu, nadużyć lub naruszeń compliance. AI może klasyfikować treści, wychwytywać słowa kluczowe lub wzorce wskazujące na konflikt.

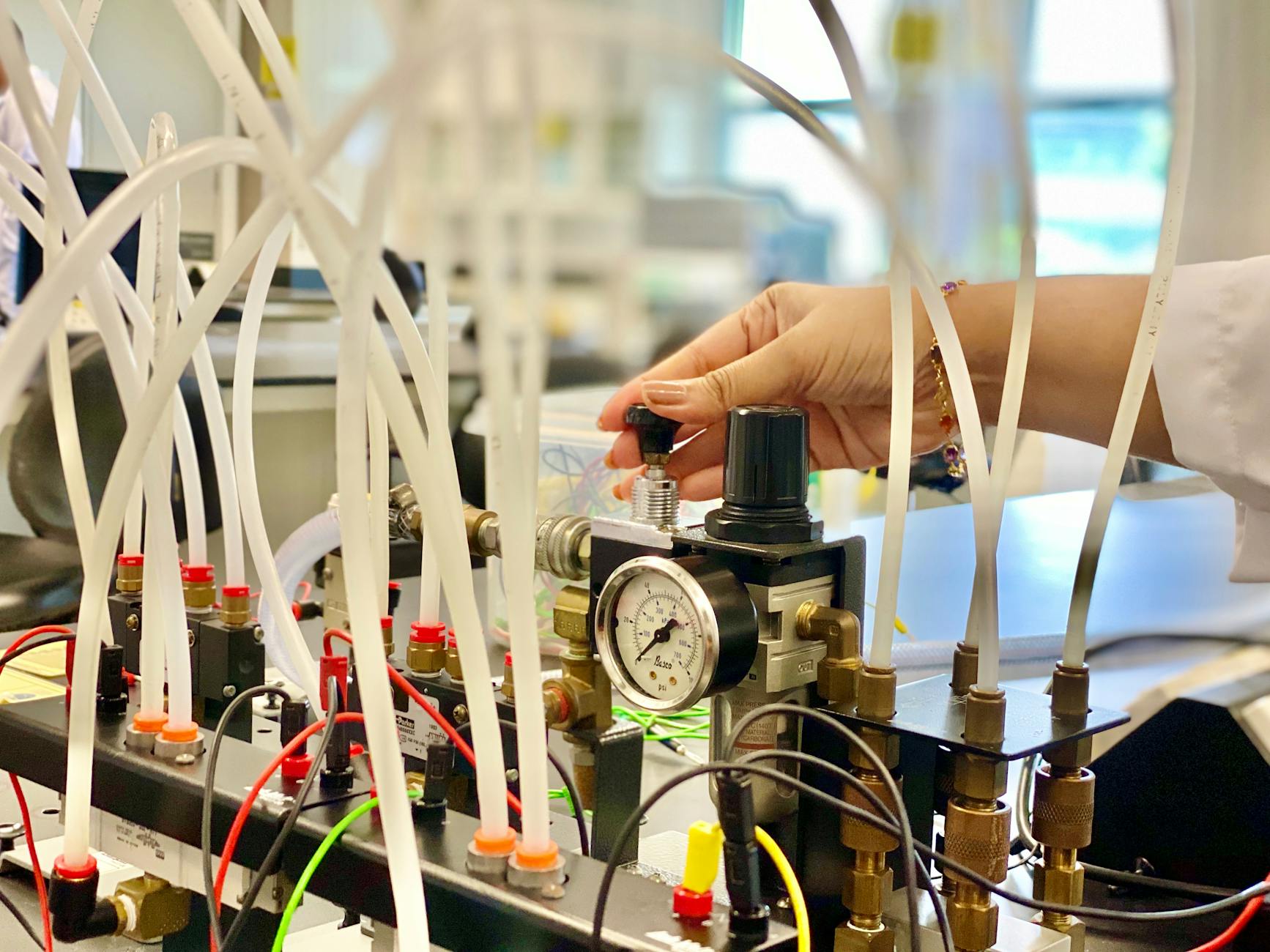

- Monitoring fizycznego środowiska pracy – kamery z analizą obrazu (rozpoznawanie ruchu, identyfikacja zdarzeń niebezpiecznych), systemy kontroli dostępu uczące się typowych tras pracowników i oznaczające anomalie, a także czujniki w magazynach i halach produkcyjnych monitorujące przestrzeganie zasad BHP.

W wielu przypadkach pracownicy mają ograniczoną świadomość, że to, co dotychczas było „zwykłym” systemem, zostało rozbudowane o funkcje oparte na algorytmach. Z punktu widzenia RODO i etyki ma to duże znaczenie – zmienia się bowiem charakter przetwarzania danych oraz skala możliwych konsekwencji dla osób monitorowanych.

Granica między kontrolą pracy a życiem prywatnym

Polski kodeks pracy i orzecznictwo co do zasady uznają prawo pracodawcy do kontroli sposobu wykonywania obowiązków. Nie oznacza to jednak zgody na pełną kontrolę całej aktywności pracownika, niezależnie od celu czy kontekstu. AI w monitoringu pracowników łatwo przesuwa tę granicę, bo umożliwia przetwarzanie zdecydowanie szerszego spektrum danych, niż jest niezbędne do oceny pracy.

Przykładowo: narzędzie analizujące metadane połączeń służbowych może „przy okazji” odsłonić kontakty z organizacją związkową, lekarzem, prawnikiem czy innymi podmiotami, które pracownik chciałby zachować w sferze prywatnej. System mierzący czas przed ekranem przy pracy zdalnej, jeśli jest źle skonfigurowany, może rejestrować również aktywność w prywatnych aplikacjach, np. podczas przerwy.

Przepisy oraz praktyka organów nadzorczych (jak UODO) wymagają, aby nadzór był adekwatny do celu i prowadzony w sposób jak najmniej ingerujący w prywatność. Oznacza to chociażby unikanie monitorowania prywatnych folderów, komunikacji oznaczonej jako „prywatna” czy przestrzeni, gdzie z natury sfera osobista przeważa (np. szatnie, toalety). W przypadku narzędzi AI konieczna jest również kontrola tego, jak algorytm przetwarza i łączy dane, bo granica pomiędzy danymi „służbowymi” a informacjami o życiu prywatnym bywa bardzo płynna.

Praca zdalna, urządzenia mobilne i „rozlanie się” monitoringu

Rozwój pracy zdalnej i hybrydowej spowodował, że monitoring pracowników przestał się ograniczać do biura czy zakładu pracy. Systemy nadzoru wchodzą na prywatne laptopy (BYOD), smartfony, domowe sieci Wi‑Fi. W połączeniu z AI taki monitoring może objąć bardzo szeroki zakres danych: od lokalizacji urządzenia, przez ruch sieciowy, po aplikacje instalowane na prywatnym sprzęcie.

W praktyce rodzi to kilka istotnych problemów:

- trudno jednoznacznie oddzielić czas pracy od czasu prywatnego, jeśli urządzenie jest to samo,

- monitoring aplikacji lub historii przeglądania może przypadkowo obejmować dane intymne (zdrowie, orientacja, poglądy),

- pracownik często nie ma świadomości, które funkcje urządzenia są monitorowane i przez kogo (pracodawca vs dostawca oprogramowania).

Przy wdrażaniu AI w monitoringu pracowników w środowisku zdalnym trzeba więc precyzyjnie określić: które urządzenia są objęte nadzorem, jakie dane są zbierane, w jakich godzinach, jak odróżnić aktywność zawodową od prywatnej. Z punktu widzenia RODO i zaufania pracowników kluczowe jest to, aby monitoring nie zamieniał się w obserwację całego życia prowadzonego „przy okazji” pracy zdalnej.

Podstawy prawne monitoringu – co wolno pracodawcy, a czego nie

Kodeks pracy i przepisy szczególne

Monitoring pracowników ma w polskim porządku prawnym przede wszystkim dwa filary: kodeks pracy oraz przepisy o ochronie danych osobowych, w tym RODO. Kodeks pracy określa ogólne zasady nadzoru: pracodawca ma prawo kontrolować sposób wykonywania pracy i organizować proces pracy, ale z poszanowaniem godności i innych dóbr osobistych pracownika. Oznacza to konieczność stałego ważenia interesów: interesu pracodawcy (bezpieczeństwo, efektywność, ochrona mienia) z interesem pracownika (prywatność, wolność komunikowania się, zaufanie).

W odniesieniu do konkretnych form monitoringu istnieją przepisy szczególne, np. dotyczące:

- monitoringu wizyjnego – może być stosowany wyłącznie w ściśle wskazanych celach (bezpieczeństwo, ochrona mienia, tajemnice przedsiębiorstwa, kontrola produkcji, zachowanie w tajemnicy informacji, których ujawnienie mogłoby narazić pracodawcę na szkodę);

- kontroli służbowej poczty e‑mail – musi być powiązana z celem organizacji pracy lub właściwego wykorzystania narzędzi pracy, przy poszanowaniu tajemnicy korespondencji;

- monitoringu GPS pojazdów służbowych – dopuszczalny w granicach celów związanych z bezpieczeństwem, kontrolą wykorzystania floty, ochroną mienia i organizacją pracy;

- kontroli trzeźwości i środków działających podobnie do alkoholu – może być wprowadzona na warunkach przewidzianych przepisami, z odpowiednią procedurą i informowaniem pracowników.

Te przepisy powstały z myślą o „tradycyjnych” formach nadzoru, jednak stosuje się je również do narzędzi zawierających elementy AI. Jeżeli więc kamera jest „inteligentna” (np. analizuje zachowania albo liczy czas przebywania w strefie), nadal obowiązują ograniczenia co do celu, zakresu i przechowywania nagrań, a dodatkowo dochodzą wymogi związane z profilowaniem. To samo dotyczy narzędzi do monitoringu komputerów czy poczty e‑mail – fakt wykorzystania AI nie tworzy odrębnego reżimu prawnego, lecz rozszerza analizę pod kątem RODO.

RODO i inne regulacje unijne

Każdy monitoring pracowników, który wymaga identyfikacji osoby fizycznej lub umożliwia ją pośrednio, stanowi przetwarzanie danych osobowych. RODO działa tu jak „parasol” obejmujący wszystkie operacje na danych: zbieranie, przechowywanie, analizę, profilowanie, udostępnianie. AI w monitoringu pracowników nie jest wyjątkiem – przeciwnie, najczęściej wchodzi w obszar przetwarzania na dużą skalę i w sposób systematyczny, co wiąże się z dodatkowymi obowiązkami (np. ocena skutków dla ochrony danych – DPIA).

RODO wymaga od pracodawcy m.in.:

- wykazania legalnej podstawy przetwarzania (np. uzasadniony interes pracodawcy),

- określenia jasno zdefiniowanych celów monitoringu i niedokonywania dalszego przetwarzania niezgodnego z tymi celami,

- stosowania zasady minimalizacji danych – zbierania tylko tych informacji, które są niezbędne,

- ograniczenia okresu przechowywania danych,

- zapewnienia przejrzystości – jasne komunikaty dla pracowników, na czym polega przetwarzanie,

- wdrożenia adekwatnych środków bezpieczeństwa (organizacyjnych i technicznych).

W kontekście AI kluczowe są również przepisy dotyczące zautomatyzowanego podejmowania decyzji oraz profilowania. Jeżeli wynik działania systemu (np. scoring „ryzyka odejścia” czy „poziomu zaangażowania”) ma istotny wpływ na sytuację pracownika, wchodzi w grę art. 22 RODO, który wprowadza dodatkowe ograniczenia i obowiązki informacyjne.

Niezależnie od RODO, na horyzoncie znajduje się także unijna regulacja AI Act, która klasyfikuje systemy AI wykorzystywane do monitorowania pracowników jako rozwiązania wysokiego ryzyka. Oznacza to, że zarówno dostawcy, jak i użytkownicy takich systemów będą musieli spełnić określone wymagania, m.in. w zakresie zarządzania ryzykiem, jakości danych, dokumentacji technicznej, nadzoru człowieka i przejrzystości działania algorytmów.

Profilowanie i zautomatyzowane podejmowanie decyzji

Moment, w którym monitoring z użyciem AI staje się profilowaniem w rozumieniu RODO, pojawia się wtedy, gdy dochodzi do:

- automatycznej analizy danych osobowych,

- oceny niektórych aspektów osoby fizycznej (wydajność, zachowanie, wiarygodność, preferencje),

- wyciągania wniosków lub dokonywania klasyfikacji (scoring, segmentacja).

Przykładem profilowania jest system, który analizuje historię logowań, aktywność w aplikacjach, liczbę wysłanych e‑maili i na tej podstawie przypisuje pracownikowi etykietę „wysoko zaangażowany” lub „podwyższone ryzyko nadużycia”. Jeżeli te etykiety są tylko dodatkową informacją dla przełożonego, łatwiej wykazać, że nie dochodzi do w pełni zautomatyzowanego podejmowania decyzji. Problem pojawia się, gdy algorytm de facto determinuje decyzje kadrowe: automatycznie ogranicza dostęp do systemów, wyklucza z premii, selekcjonuje kandydatów do awansu.

W takim wypadku trzeba przeanalizować, czy nie wchodzimy w obszar zautomatyzowanego podejmowania decyzji wywołującego skutki prawne lub w podobny sposób istotnie na osobę wpływające. Jeśli tak jest, na pracodawcy ciążą dodatkowe obowiązki, w tym umożliwienie pracownikowi:

- uzyskania interwencji człowieka,

- wyrażenia własnego stanowiska,

- zakwestionowania decyzji.

W praktyce bezpieczniej jest projektować systemy AI w monitoringu tak, by człowiek realnie podejmował decyzje, a algorytmy pełniły funkcję narzędzi wspierających, a nie decydujących. Wymaga to nie tylko odpowiednich zapisów w procedurach, lecz także faktycznej kontroli, jak system jest wykorzystywany przez menedżerów.

Wpływ unijnego AI Act na narzędzia nadzoru w pracy

AI Act wprowadza klasyfikację systemów AI według ryzyka. Rozwiązania używane do monitorowania pracowników i oceny ich zachowania co do zasady zaliczane są do systemów wysokiego ryzyka, co pociąga za sobą szereg wymagań dla organizacji je stosujących. Chodzi m.in. o:

Wymogi dla systemów wysokiego ryzyka a rola pracodawcy

Z perspektywy pracodawcy kluczowe w AI Act są obowiązki przypisane do użytkownika systemu wysokiego ryzyka (w języku rozporządzenia – „deployera”). Nie sprowadzają się one tylko do zakupu „zgodnego” narzędzia. Organizacja, która wdraża AI do monitoringu pracowników, musi wykazać się aktywną kontrolą nad sposobem wykorzystania systemu.

Do typowych zadań użytkownika systemu wysokiego ryzyka należą m.in.:

- ocena, czy system rzeczywiście będzie używany w sposób, który podpada pod kategorię wysokiego ryzyka (monitoring, ocena zachowania, decyzje kadrowe),

- zapewnienie, że system jest używany zgodnie z instrukcjami dostawcy (np. zakres danych wejściowych, kontekst użycia),

- wdrożenie środków umożliwiających nadzór człowieka – zarówno na etapie podejmowania decyzji, jak i w razie awarii lub nieprawidłowości,

- prowadzenie dokumentacji, która pokaże, jakie dane są wprowadzane do systemu, jakie cele przetwarzania przyjęto oraz jakie kryteria oceny stosuje algorytm,

- reagowanie na sygnały o błędach, uprzedzeniach (bias) lub skutkach nieproporcjonalnych dla części pracowników.

Przykładowo, jeśli firma korzysta z narzędzia do „analizy produktywności”, które punktuje pracowników i sugeruje działania dyscyplinujące, to po stronie pracodawcy leży obowiązek takiej konfiguracji i nadzoru, aby rekomendacje nie przechodziły w mechaniczne decyzje kadrowe. Sama umowa z dostawcą, że „system nie służy do automatycznego podejmowania decyzji”, nie wystarczy, jeżeli w praktyce menedżerowie opierają się wyłącznie na generowanych rankingach.

Transparentność i wyjaśnialność algorytmów

AI Act kładzie nacisk na przejrzystość działania systemów wysokiego ryzyka. Z punktu widzenia pracowników oznacza to, że nie powinni być oceniani przez „czarną skrzynkę”, której działania nie da się choćby ogólnie zrozumieć. Dostawca systemu ma obowiązek zapewnić użytkownikowi informacje techniczne, natomiast pracodawca musi je przełożyć na język zrozumiały dla załogi.

W praktyce chodzi o to, by pracownik mógł uzyskać informacje m.in.:

- jakie kategorie danych są analizowane przez algorytm (np. czas aktywności w systemach, rodzaj zadań, wyniki sprzedażowe),

- jakie są ogólne kryteria oceny (np. punktowanie za dotrzymywanie terminów, jakość obsługi klienta, stabilność logowań),

- czy wyniki generowane przez AI przekładają się na konkretne decyzje (premie, awanse, przydział projektów) czy są jedynie wskaźnikami pomocniczymi.

Nie oznacza to konieczności ujawniania kodu źródłowego czy pełnego modelu matematycznego. Istotne jest, by pracownik miał szansę zrozumieć, z czego może wynikać negatywna ocena i jak może ją zakwestionować. Jeżeli system wykrywa „anomalie” w aktywności przy komputerze, to pracownik powinien móc wyjaśnić np. że część pracy wykonuje w aplikacjach, których program nie rejestruje, albo że dłuższe przerwy wynikają z telefonów służbowych prowadzonych poza monitorowanym narzędziem.

Nowa sekcja wewnętrzna: polityki i procedury

AI w monitoringu pracowników zwykle wymusza aktualizację wewnętrznych dokumentów: regulaminu pracy, polityki bezpieczeństwa informacji, polityki prywatności czy szczegółowych instrukcji dla administratorów systemów. Sam ogólny zapis „pracodawca może stosować monitoring” jest niewystarczający przy tak zaawansowanych narzędziach.

W dokumentach wewnętrznych powinny znaleźć się m.in.:

- jasno określone cele monitoringu (np. bezpieczeństwo danych, zapobieganie nadużyciom, organizacja pracy, rozliczalność czasu pracy),

- opis stosowanych narzędzi – w tym wskazanie, które z nich zawierają elementy AI i do czego algorytmy są wykorzystywane,

- procedury korzystania z wyników analizy AI przez menedżerów (np. zakaz podejmowania decyzji wyłącznie na podstawie scoringu, wymóg konsultacji z HR),

- zasady dostępu do danych oraz logów monitoringu (kto, w jakich sytuacjach, na jakich poziomach szczegółowości),

- reguły retencji – jak długo przechowywane są dane pierwotne (logi, nagrania) i dane pochodne (profile, wskaźniki).

Dobrą praktyką jest powiązanie tych zapisów z konkretnymi ryzykami zidentyfikowanymi w ocenie skutków dla ochrony danych (DPIA). Pracodawca może np. zrezygnować z monitorowania określonych kategorii danych lub wprowadzić dodatkowe ograniczenia (maskowanie treści, pseudonimizacja) tam, gdzie DPIA wykazała podwyższone ryzyko naruszenia prywatności.

Jakie dane zbierają narzędzia AI do monitoringu i co z tego wynika

Dane behawioralne i wzorce aktywności

Systemy AI wykorzystywane w monitoringu pracowników koncentrują się najczęściej na tzw. danych behawioralnych, czyli informacjach o tym, jak pracownik korzysta z narzędzi pracy i jak się zachowuje w środowisku cyfrowym. Nie zawsze są to oczywiste dane osobowe jak imię czy nazwisko – często na początku mają postać anonimowych logów, które następnie są łączone z konkretną osobą.

Do tej grupy można zaliczyć m.in.:

- czasy logowania i wylogowywania z systemów, długość sesji, częstotliwość przerw,

- historię otwieranych aplikacji i plików, aktywność w określonych programach,

- wzorce ruchu myszki i klawiatury, czas reakcji na zadania czy zgłoszenia,

- informacje o lokalizacji urządzenia, zmianie sieci, łączeniu się z nietypowych miejsc.

Na podstawie takich danych algorytm może tworzyć profile „typowego dnia pracy” dla poszczególnych stanowisk czy osób, a następnie wyłapywać odchylenia od wzorca. Powstaje jednak ryzyko nadmiernej ingerencji w sposób organizowania pracy: system może np. preferować osoby pracujące w trybie stałych, nieprzerwanych bloków aktywności, a gorzej oceniać tych, którzy pracują intensywnie, ale z częstymi krótkimi przerwami, mimo że w obu przypadkach całościowy wynik jest porównywalny.

Dane treściowe: komunikacja, dokumenty, nagrania

Coraz częściej narzędzia AI sięgają także po treść komunikacji i dokumentów, a nie jedynie po metadane. Analiza obejmuje wtedy m.in.:

- treść wiadomości e‑mail i czatów służbowych,

- zawartość dokumentów tworzonych i modyfikowanych przez pracowników,

- nagrania rozmów telefonicznych lub spotkań wideo (np. w celu analizy jakości obsługi klienta).

AI może tu pełnić rolę narzędzia wspierającego compliance (wykrywanie słów kluczowych świadczących o naruszeniach procedur, np. ujawnianiu tajemnicy przedsiębiorstwa) albo HR (analiza tonu wypowiedzi, poziomu „zaangażowania” w dyskusje zespołowe). Im bardziej system ingeruje w treść komunikacji, tym trudniej utrzymać równowagę między interesem pracodawcy a prawem pracownika do prywatności i tajemnicy korespondencji.

W praktyce bezpieczniejszym rozwiązaniem jest ograniczanie analizy treści do ściśle zdefiniowanych, udokumentowanych celów, przy zastosowaniu mechanizmów minimalizacji – np. analizowanie jedynie treści komunikacji z klientami, a nie korespondencji wewnętrznej, lub ograniczanie zakresu słów kluczowych do pojęć bezpośrednio związanych z naruszeniami bezpieczeństwa.

Dane wrażliwe i informacje pochodne

Szczególne ryzyko pojawia się w obszarze tzw. danych szczególnej kategorii (dawniej: danych wrażliwych), takich jak informacje o zdrowiu, przekonaniach, orientacji czy przynależności związkowej. Zwykle pracodawca nie planuje ich gromadzenia w ramach monitoringu, jednak system AI może je pośrednio „wywnioskować” z analizy zachowań lub treści.

Przykładowo, analiza historii przeglądania może wskazywać na częste odwiedzanie serwisów medycznych poświęconych określonej chorobie, a analiza korespondencji – na udział w działalności związkowej. Tego typu informacje nie powinny być ani punktem odniesienia dla oceny pracownika, ani w ogóle utrwalane, chyba że istnieje wyraźna podstawa prawna (co w relacji pracodawca–pracownik występuje bardzo rzadko).

AI Act i RODO podkreślają przy tym ryzyko wnioskowania cech wrażliwych na podstawie pozornie neutralnych danych. W praktyce oznacza to konieczność takiego projektowania i konfiguracji systemów, aby:

- nie trenowały modeli na cechach, które mogą prowadzić do rozpoznawania danych szczególnych kategorii,

- nie oferowały funkcjonalności pozwalających na tworzenie profili zdrowotnych, światopoglądowych czy związkowych pracowników,

- blokowały lub anonimizowały dane, które „przy okazji” mogą ujawniać takie informacje.

Konsekwencje zbierania danych dla relacji pracodawca–pracownik

Im szerszy zakres danych zbiera system monitorujący, tym większe ryzyko utraty zaufania w relacji pracodawca–pracownik. Nawet jeśli rozwiązanie jest zgodne z przepisami, to przy braku przejrzystości może być odbierane jako nadmierna inwigilacja. Zwykle przekłada się to na:

- zahamowanie inicjatywy – pracownicy wybierają „bezpieczne” zachowania, zamiast szukać lepszych sposobów pracy,

- obniżenie gotowości do zgłaszania błędów i problemów – obawa, że każde odstępstwo od normy zostanie zinterpretowane na niekorzyść,

- zwiększoną rotację w zespołach, szczególnie wśród specjalistów wyczulonych na kwestie prywatności.

Dlatego przy projektowaniu zakresu monitoringu z użyciem AI warto oprócz analizy prawnej przeprowadzić również analizę „społeczną”: czy dane, które formalnie można zebrać, rzeczywiście są potrzebne, czy przynoszą realną wartość, czy da się osiągnąć ten sam cel przy mniejszej ingerencji. Często okazuje się, że wystarczają dane zagregowane lub zanonimizowane na poziomie zespołu, bez schodzenia do szczegółów dotyczących konkretnej osoby.

Zgoda, obowiązek informacyjny, uzasadniony interes – na czym oprzeć monitoring AI

Dlaczego zgoda pracownika rzadko jest właściwą podstawą

Na gruncie RODO intuicyjną odpowiedzią na pytanie o legalność monitoringu bywa „trzeba wziąć zgodę”. W relacji pracodawca–pracownik jest to jednak co do zasady wadliwa podstawa. Zgoda powinna być dobrowolna, a w stosunku zależności, jakim jest stosunek pracy, trudno mówić o pełnej swobodzie decyzji. Pracownik może odczuwać presję, że odmowa zgody będzie miała dla niego negatywne konsekwencje, nawet jeśli formalnie tak nie jest.

Organy nadzorcze w Unii konsekwentnie wskazują, że w przypadku monitoringu pracowników zgoda powinna być stosowana wyjątkowo. Może mieć sens np. wtedy, gdy monitoring nie jest niezbędny do realizacji obowiązków pracodawcy, a dotyczy dodatkowych, wyraźnie korzystnych dla pracownika funkcjonalności (np. dobrowolne narzędzie do samooceny dobrostanu psychicznego, z użyciem AI, z którego można w każdej chwili zrezygnować bez żadnych konsekwencji).

W typowych scenariuszach nadzoru (bezpieczeństwo systemów, organizacja pracy, ochrona mienia) podstawę prawną stanowi raczej uzasadniony interes pracodawcy lub – w niektórych przypadkach – obowiązek prawny (np. specyficzne wymogi branżowe dotyczące logowania dostępu).

Uzasadniony interes jako podstawa monitoringu AI

Uzasadniony interes (art. 6 ust. 1 lit. f RODO) jest najczęściej stosowaną podstawą dla monitoringu, także z użyciem AI. Nie jest to jednak „pusta formuła”, którą można dowolnie wpisać w klauzulę informacyjną. Pracodawca musi przeprowadzić tzw. test równowagi, w którym:

- identyfikuje swój interes (np. zapewnienie bezpieczeństwa informacji, przeciwdziałanie nadużyciom, zapewnienie ciągłości działania systemów),

- ocenia, czy jest on rzeczywisty i prawnie uzasadniony, a nie wyłącznie hipotetyczny lub „na zapas”,

- porównuje ten interes z prawami i wolnościami pracowników, biorąc pod uwagę skalę i intensywność monitoringu,

- wprowadza środki łagodzące, jeśli monitoring może istotnie ingerować w prywatność (np. ograniczenie zakresu danych, anonimizacja, skrócenie czasu retencji).

W kontekście AI istotny jest także interes pracowników. System może np. pomagać w wykrywaniu przeciążenia pracą lub mobbingu (analiza wzorców komunikacji), co potencjalnie służy ochronie ich praw. W takim przypadku uzasadniony interes nie jest wyłącznie „po stronie pracodawcy”, ale obejmuje szerszy cel – poprawę warunków pracy. Nie zwalnia to jednak z konieczności przejrzystego poinformowania o stosowanych narzędziach i możliwości zakwestionowania sposobu ich wykorzystania.

Obowiązek informacyjny – jak mówić o AI w monitoringu

Jak zrealizować obowiązek informacyjny przy monitoringu z użyciem AI

Obowiązek informacyjny z art. 13 RODO nie ogranicza się do zdania „pracownik podlega monitoringowi”. W kontekście AI chodzi o możliwie konkretne i zrozumiałe opisanie, co dokładnie robi system, jakie dane przetwarza oraz jakie mogą być tego skutki dla pracownika.

Przygotowując klauzule informacyjne, pracodawca powinien w szczególności:

- nazwać stosowane narzędzia (np. kategorie systemów: analiza logów, monitoring aktywności, analiza korespondencji z klientami) i wskazać, czy wykorzystują one mechanizmy sztucznej inteligencji lub uczenia maszynowego,

- opisać cele monitoringu w sposób operacyjny, a nie ogólnikowy („zapewnienie bezpieczeństwa informacji poprzez analizę logów dostępu do systemów w celu wykrywania nietypowej aktywności”),

- wylistować kategorie danych, które są przetwarzane – także tych „pochodnych”, generowanych przez algorytm (np. profil ryzyka nadużyć, ocena zgodności zachowań z procedurami),

- wskazać podstawę prawną dla każdego z głównych celów monitoringu (uzasadniony interes, obowiązek prawny, wyjątkowo – zgoda),

- wyjaśnić logikę działania systemu w zakresie, w jakim ma on istotny wpływ na sytuację pracownika (np. czy wyniki analizy AI są jedynie rekomendacją dla człowieka, czy mogą automatycznie wpływać na decyzje kadrowe),

- określić czas przechowywania danych i kryteria jego ustalania (np. logi szczegółowe przechowywane przez 3 miesiące, dane zagregowane przez 12 miesięcy),

- poinformować o prawach pracownika – w tym o prawie sprzeciwu wobec przetwarzania danych na podstawie uzasadnionego interesu, dostępu do danych i uzyskania wyjaśnień, jak działa system.

Treść obowiązku informacyjnego nie powinna być ukryta wyłącznie w regulaminie pracy czy polityce bezpieczeństwa. Praktycznym rozwiązaniem bywa połączenie kilku kanałów: klauzuli przekazywanej przy zatrudnieniu, informacji na intranecie, krótkiego komunikatu przy pierwszym logowaniu do monitorowanego systemu, a także regularnego przypominania o zasadach monitoringu przy okazji aktualizacji narzędzi.

W przypadku wdrożenia nowego systemu AI dobrym krokiem jest również zorganizowanie krótkiego spotkania informacyjnego z zespołami. Można wtedy w prosty sposób pokazać, jakie dane są widoczne dla pracodawcy, a jakich system nie zbiera, co często znacząco obniża poziom niepokoju.

Informowanie o profilowaniu i zautomatyzowanym podejmowaniu decyzji

RODO wymaga dodatkowych informacji, gdy dochodzi do zautomatyzowanego podejmowania decyzji wywołującego skutki prawne lub w podobny sposób istotnie wpływającego na osobę. W kontekście AI w monitoringu pracowników takie sytuacje zdarzają się np. wtedy, gdy:

- wynik analizy algorytmu automatycznie skutkuje wszczęciem procedury wyjaśniającej lub blokadą dostępu do systemów,

- algorytm przyznaje pracownikom określone „oceny” efektywności, które bezpośrednio przekładają się na premie czy decyzje o awansie.

Jeśli system ma pełnić taką rolę, pracownik powinien zostać wprost poinformowany m.in. o tym:

- że wobec jego danych stosowane jest profilowanie,

- na jakich zasadach odbywa się ocena (ogólna logika, główne kryteria),

- jakie konsekwencje może mieć dana klasyfikacja czy wynik modelu,

- że przysługuje mu prawo do zakwestionowania decyzji, uzyskania interwencji człowieka oraz wyjaśnienia, dlaczego zapadło konkretne rozstrzygnięcie.

W praktyce wiele organizacji deklaruje, że decyzje kadrowe i dyscyplinarne zapadają „zawsze w oparciu o ocenę człowieka”, ale jednocześnie nadaje wynikom algorytmu tak duże znaczenie, że stanowią one faktycznie przesądzającą przesłankę. W takim modelu trudno mówić o realnym „udziale człowieka” – jest to raczej formalne potwierdzanie tego, co podpowiedział system. Taki sposób działania wymaga krytycznej oceny, zarówno pod kątem RODO, jak i zasad etycznych.

Granice uzasadnionego interesu – kiedy monitoring staje się nadmierny

Odwołanie się do uzasadnionego interesu nie usprawiedliwia monitoringu prewencyjnego bez wyraźnego celu. W praktyce problemem są szczególnie projekty, w których dostawca narzędzia AI obiecuje „wykrywanie wszelkich nieprawidłowości” bez precyzyjnego opisania, co to oznacza. Pracodawca, który akceptuje takie podejście, ryzykuje, że:

- przetwarza dane w sposób nieproporcjonalny do celu (np. pełna analiza treści korespondencji wewnętrznej „na wypadek” potencjalnego naruszenia),

- tworzy profile o bardzo szerokim zakresie, obejmujące zachowania, które nie mają znaczenia z punktu widzenia bezpieczeństwa czy organizacji pracy,

- de facto prowadzi nieprzerwany nadzór w czasie rzeczywistym bez wyraźnego uzasadnienia.

Uzasadniony interes ma swoją granicę tam, gdzie monitoring przestaje być konieczny i proporcjonalny. W procesie oceny tej granicy pomocne jest zadanie kilku prostych pytań:

- czy ten sam cel można osiągnąć przy mniejszej szczegółowości danych (np. analizy w ujęciu zespołowym zamiast indywidualnym),

- czy zakres monitoringu da się ograniczyć do określonych sytuacji podwyższonego ryzyka (np. włączenie pełnej analizy treści tylko w razie sygnałów o nadużyciu),

- czy wszystkie funkcje oferowane przez system są rzeczywiście potrzebne, czy są „włączone domyślnie” tylko dlatego, że tak zaprojektował je producent.

Typowym przykładem przekroczenia granic jest sytuacja, w której narzędzie AI śledzi nie tylko aktywność w systemach służbowych, lecz także prywatne wykorzystanie urządzenia, nawet jeśli regulamin dopuszcza taki użytek w rozsądnym zakresie. Kontrola przeglądanych treści na portalach społecznościowych w czasie przerwy obiadowej trudno obronić testem proporcjonalności, szczególnie w modelu pracy zdalnej czy hybrydowej.

Minimalizacja danych i konfiguracja systemu AI

Art. 5 RODO wprowadza zasadę minimalizacji danych: przetwarzane mają być tylko te informacje, które są niezbędne do osiągnięcia konkretnego celu. W przypadku narzędzi AI do monitoringu realizacja tej zasady zależy w dużej mierze od ich konfiguracji.

Przed wdrożeniem systemu warto wspólnie z dostawcą i działem IT przeanalizować:

- które funkcje są obligatoryjne, a które można wyłączyć lub ograniczyć (np. monitoring treści czatów wewnętrznych vs. analiza wyłącznie komunikacji z klientami),

- jakie parametry można „przytępić” – np. zamiast śledzenia co do minuty aktywności myszki i klawiatury, zastosować przedziały czasowe lub progi aktywności,

- w jakim zakresie da się stosować anonimizację lub pseudonimizację, szczególnie przy raportach zbiorczych dla zarządu,

- jak szybko dane mogą być agregowane, tak aby szczegółowe informacje o pojedynczych działaniach nie były przechowywane dłużej, niż to konieczne.

Dobrym kierunkiem jest projektowanie rozwiązań w duchu privacy by default, tzn. z ustawieniami domyślnymi, które są bardziej oszczędne w zakresie zbieranych danych. Jeżeli organizacja ma realną potrzebę ich rozszerzenia, decyzja o zmianie konfiguracji powinna być udokumentowana, poprzedzona analizą ryzyka i odpowiednio zakomunikowana pracownikom.

Ocena skutków dla ochrony danych (DPIA) przy monitoringu AI

Przetwarzanie danych w związku z monitoringiem pracowników, zwłaszcza przy wykorzystaniu AI, bardzo często spełnia przesłanki obowiązkowej oceny skutków dla ochrony danych (DPIA – Data Protection Impact Assessment) z art. 35 RODO. Taka ocena jest wymagana m.in., gdy przetwarzanie ma charakter:

- systematycznego i szeroko zakrojonego monitorowania osób,

- dotyczy danych wrażliwych lub pozwala na ich wnioskowanie,

- opiera się na nowych technologiach o wysokim stopniu złożoności.

DPIA nie jest jedynie „technicznym załącznikiem” do wdrożenia. Powinna zawierać m.in.:

- opis planowanych operacji przetwarzania i celów monitoringu,

- ocenę konieczności i proporcjonalności przetwarzania (czy na pewno nie ma mniej inwazyjnych środków),

- analizę ryzyka naruszenia praw i wolności pracowników (np. ryzyka dyskryminacji, błędnego oznaczania „podejrzanych” zachowań, efektu mrożącego),

- środki planowane w celu ograniczenia ryzyka (np. dodatkowe zabezpieczenia techniczne, ograniczenia dostępu, procedury weryfikacji wyników algorytmu).

W proces DPIA dobrze jest włączyć nie tylko dział prawny i bezpieczeństwa, lecz także przedstawicieli HR oraz – w miarę możliwości – reprezentację pracowników (np. związek zawodowy lub radę pracowników). Taki dialog pomaga wychwycić ryzyka, które z perspektywy stricte prawnej mogłyby pozostać niewidoczne, np. obawy przed piętnowaniem osób o niestandardowym rytmie pracy czy specyficznych potrzebach zdrowotnych.

Rola dostawcy systemu a odpowiedzialność pracodawcy

W wielu wdrożeniach narzędzi AI do monitoringu dostawca systemu występuje jako podmiot przetwarzający (procesor) w rozumieniu RODO, a pracodawca jako administrator danych. Nie zmienia to faktu, że to pracodawca odpowiada za zgodność całości przetwarzania z prawem, w tym za wybór narzędzia o odpowiednich parametrach prywatności.

Umowa powierzenia przetwarzania danych z dostawcą systemu powinna regulować m.in.:

- dokładny zakres i cel przetwarzania, w tym ewentualne wykorzystanie danych do dalszego trenowania modeli przez dostawcę,

- kategorie danych i okres ich przechowywania po stronie dostawcy,

- środki bezpieczeństwa, w tym szyfrowanie, kontrolę dostępu i rejestrowanie operacji,

- zasady podpowierzenia danych kolejnym podmiotom (np. dostawcom chmury),

- procedury wsparcia administratora w realizacji praw osób, których dane dotyczą (np. odpowiedzi na wnioski o dostęp, sprostowanie, sprzeciw).

Problemem są rozwiązania typu „software as a service”, w których standardowy regulamin dostawcy przewiduje szerokie wykorzystanie danych klientów do „ulepszania algorytmów”. W relacji pracodawca–pracownik oznaczałoby to, że dane pracowników z monitoringu są wykorzystywane także dla innych celów niż te, które uzasadnia administrator. Taka praktyka wymaga szczególnie krytycznego spojrzenia, a często – negocjacji umownych i ograniczenia zakresu danych przekazywanych dostawcy.

AI w monitoringu a prawo pracy i zasady współżycia społecznego

Oprócz RODO i AI Act zastosowanie mają również przepisy krajowego prawa pracy, w tym regulujące monitoring wizyjny, pocztowy czy lokalizacyjny. W polskim porządku prawnym pracodawca ma obowiązek m.in.:

- określić cele i zakres monitoringu w aktach wewnętrznych (regulamin pracy, układ zbiorowy),

- poinformować pracowników o wprowadzeniu monitoringu odpowiednio wcześniej,

- szanować sferę prywatności, np. nie obejmować monitoringu pomieszczeń socjalnych, szatni czy sanitariatów (z bardzo wąskimi wyjątkami).

AI dodaje do tego nowy wymiar: monitorowanie może być znacznie bardziej „gęste”, a analiza – zdecydowanie głębsza. Ustawowe przepisy nie zawsze wprost regulują takie scenariusze, dlatego kluczowe stają się ogólne zasady prawa pracy, jak obowiązek poszanowania godności i innych dóbr osobistych pracownika oraz zasady współżycia społecznego.

Jeżeli system AI prowadzi do efektu „stałego podejrzenia” wobec pracowników, generuje częste fałszywe alarmy lub umożliwia szczegółowe śledzenie aktywności poza oczywistymi godzinami i miejscami pracy, może to być ocenione jako naruszenie tych zasad, nawet przy formalnym zachowaniu wymogów RODO. W sporach sądowych coraz częściej analizuje się nie tylko treść regulaminów, ale także realne praktyki oraz to, czy pracodawca potrafi uzasadnić, iż poziom kontroli był rzeczywiście uzasadniony charakterem działalności.

Przejrzystość wobec pracowników i dialog przy wdrażaniu AI

Nawet najlepiej zaprojektowane narzędzie monitorujące może zostać odrzucone przez zespół, jeśli zostanie wdrożone „po cichu” albo zakomunikowane wyłącznie językiem technicznym. Przy projektowaniu AI w monitoringu pomocne są trzy elementy:

- Wczesne włączenie pracowników – poinformowanie o planowanym wdrożeniu na etapie projektowania, możliwość zadania pytań, zgłoszenia obaw. Często to pracownicy najlepiej wskazują sytuacje, w których monitoring może być szczególnie dotkliwy lub prowadzić do błędnych wniosków systemu.